L'iPhone 16 n'est pas le Google Pixel killer que j'espérais

L'IA est le mot à la mode aujourd'hui. Et si vous avez un iPhone, l'intelligence d'Apple est en train de bourdonner partout. L'iPhone 16 est le premier téléphone construit avec l'Apple Intelligence en tête, et que vous en achetiez un cette semaine ou non, il est difficile d'y échapper.

En juin dernier, lorsqu'Apple a présenté en avant-première sa suite d'IA qui arriverait sur les appareils compatibles le mois prochain, j'étais persuadé que l'entreprise réserverait les fonctionnalités exclusives de l'Apple Intelligence à l'iPhone 16. Après tout, la gamme Google Pixel, en constante expansion, vient de dévoiler une tonne de fonctionnalités d'IA qui ne manqueront pas de séduire certains utilisateurs d'iOS, et je m'attendais donc à ce qu'Apple ait sûrement quelques tours de passe-passe exclusifs en matière d'IA dans sa manche pour les empêcher de quitter l'appareil. J'avais tort.

Rien de nouveau

Si vous cherchez une liste complète des avantages exclusifs de l'iPhone 16 en matière d'IA, il n'y en a qu'un seul : Visual Intelligence. Cet outil, qui ne sera pas disponible au lancement comme le reste de l'Apple Intelligence, est activé à l'aide du nouveau bouton Camera Control pour permettre aux utilisateurs de scanner un objet ou un lieu afin d'effectuer une action pertinente ou d'en apprendre davantage à son sujet.

Par exemple, vous pouvez pointer l'appareil photo de votre iPhone 16 sur un chien pour identifier sa race. De même, vous pouvez consulter la liste OpenTable d'un restaurant après avoir scanné son enseigne, ou ajouter un événement à votre calendrier en vous basant sur les détails d'une affiche de concert. Il existe également un utilitaire intégré de résolution de problèmes mathématiques qui s'appuie sur l'intelligence de ChatGPT pour aider les étudiants à faire leurs devoirs.

Bien que l'intelligence visuelle soit sans aucun doute un ajout bienvenu, elle est trop décevante par rapport aux progrès réalisés par les entreprises concurrentes dans le domaine de l'IA. Google Lens fonctionne de manière similaire et existe sur tous les smartphones concernés depuis des années. En fait, les utilisateurs de l'iPhone 15 Pro peuvent déjà utiliser le bouton Action pour déclencher la fonction s'ils ont installé l'application Google officielle. Il est donc pour le moins décevant qu'Apple la clone et la propose comme seule fonction d'IA exclusive.

L'Apple Intelligence est intégrée à l'iPhone 16, mais la plupart des fonctionnalités ne seront pas disponibles avant l'année prochaine.

L'histoire de deux intelligences

La différence la plus importante entre les philosophies de Google et d'Apple est peut-être, pour reprendre l'un des mots emblématiques d'Apple, le courage. L'ancienne société est tristement célèbre pour avoir développé et lancé toutes sortes de fonctionnalités sauvages, puis pour les avoir supprimées au hasard, probablement sur la base d'indicateurs internes. Google n'a pas nécessairement peur de sortir un mauvais produit. Il essaie, s'adapte en conséquence et passe à autre chose lorsque c'est nécessaire.

Apple, en revanche, a une réputation à préserver. L'entreprise est connue pour mener des expériences approfondies en interne plutôt que d'utiliser sa base d'utilisateurs comme alpha testeurs. En conséquence, elle propose généralement des solutions fiables qui sont soit en retard, soit absentes lorsqu'elles sont juxtaposées à celles d'autres marques. Cependant, ces solutions sont généralement douces et stables, ce que les utilisateurs d'iPhone apprécient. Mais avec Apple Intelligence, il semble qu'Apple ait voulu prendre des risques pour rattraper Google et Samsung, en commençant par l'iPhone 16.

Ce n'est pas le cas. Les téléphones Pixel sont truffés de fonctionnalités d'IA qui améliorent véritablement la meilleure fonction du téléphone, l'appareil photo. Vous pouvez repeindre un objet sur une photo (Reimagine), modifier l'arrière-plan (Magic Editor), vous ajouter à une photo de groupe (Add Me), minimiser la pixellisation sur les photos zoomées (Zoom Enhance), assembler plusieurs photos en une seule (Best Take), etc. Sans parler de la fonction vidéo à double exposition qui permet de conserver des couleurs précises sur l'ensemble du cadre. Ces options offrent aux utilisateurs un contrôle total sur les résultats de leur appareil photo, ce qui leur permet d'obtenir des résultats créatifs et améliorés. Je regarde ensuite mon pitoyable iPhone, qui ne prend en charge que la suppression des objets gênants avec la fonction Nettoyer lorsqu'il s'agit d'éditer des photos à l'aide de l'IA.

Le Pixel ressemble davantage à un téléphone à intelligence artificielle que l'iPhone 16.

Au-delà des fonctionnalités liées aux médias, les téléphones Google Pixel récents peuvent également effectuer certaines tâches soignées grâce à l'IA. Il s'agit notamment de répondre au téléphone et de répondre aux appels au nom des utilisateurs, d'avoir des conversations plus naturelles avec Gemini, etc. On a vraiment l'impression d'avoir affaire à un véritable smartphone à IA plutôt qu'à un smartphone saupoudré d'IA perfide.

L'intelligence d'Apple n'est pas assez intelligente

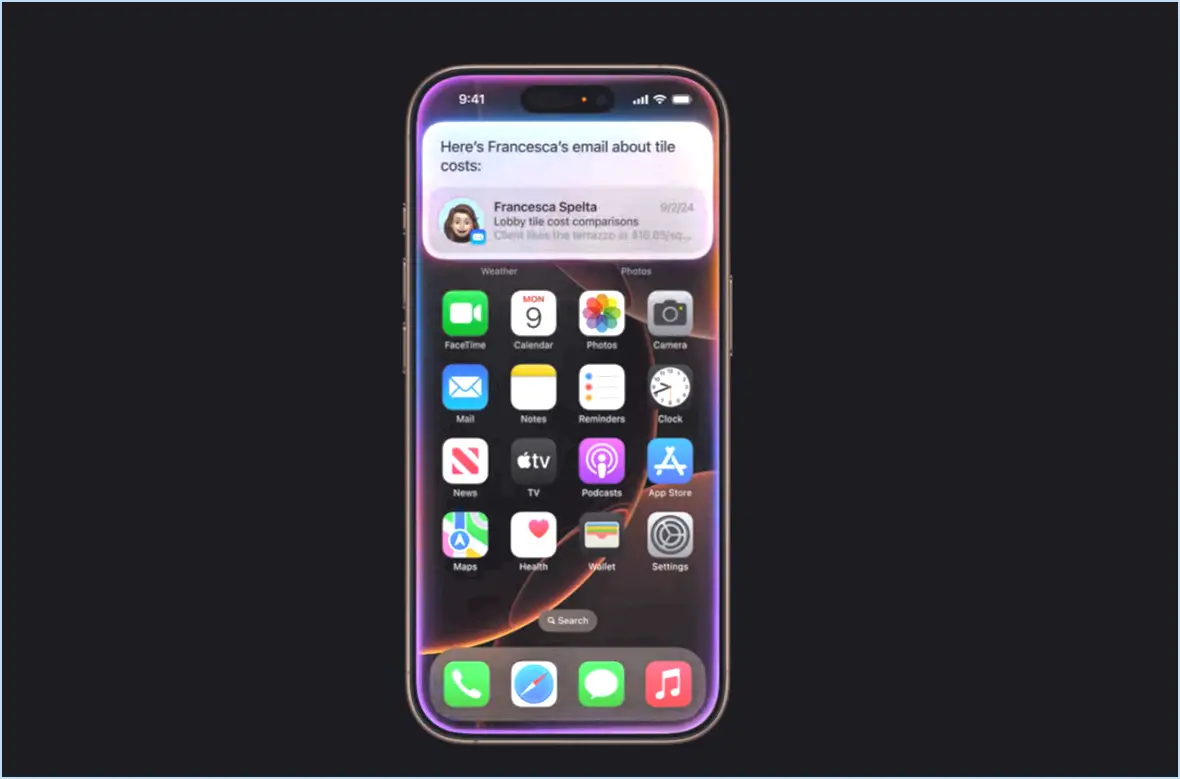

Tout cela ne veut pas dire qu'Apple Intelligence n'est pas un excellent début. Les outils de rédaction de la version bêta d'iOS 18.1 corrigent mes articles depuis des semaines. Et l'IA sur l'iPhone résume habilement les notifications, les courriels, les messages et les articles sur le web, autant de fonctionnalités utiles qui complètent parfaitement mes flux de travail basés sur le texte, et la plupart d'entre elles fonctionnent hors ligne.

Il convient également de noter qu'Apple Intelligence est gratuit, tandis que certaines des fonctionnalités d'IA de Google nécessitent un abonnement Gemini Advanced (ou le seront une fois le délai de grâce du Pixel 9 écoulé). Pour la défense de Google, cependant, les analystes suggèrent qu'Apple pourrait commencer à facturer les nouvelles fonctionnalités d'IA également dans quelques années, une fois que son produit sera arrivé à maturité. Et compte tenu de la complexité des fonctionnalités d'IA actuelles de Google, on peut dire que le tarif est justifié et que de nombreuses fonctionnalités géniales de Gemini sont gratuites.

![]()

Le Pixel 9 est chargé de fonctionnalités d'IA utiles.

Outre le fait que l'Apple Intelligence est nettement moins intelligente que son homologue de Google, l'ensemble des fonctionnalités ne fera pas ses débuts avant le milieu de l'année 2025. Ainsi, alors qu'Apple fait déjà la publicité d'un Siri plus intelligent capable d'extraire des données utilisateur des applications, la fonctionnalité n'arrivera pas réellement avant l'année prochaine. En fait, les utilisateurs de l'iPhone 16 ne bénéficieront d'aucune fonctionnalité d'Apple Intelligence avant le mois prochain, des ajouts plus intéressants impliquant des images génératives devant suivre en 2025. Les fonctionnalités Pixel de Google sont toutes disponibles dès maintenant.

Apple tente de faire miroiter un iPhone qui est objectivement moins avancé que ses concurrents actuels, ce qui n'est pas très reluisant. Tout cela est symptomatique de la volonté d'Apple de rester dans la course à l'IA, qui se déroule à un rythme effréné. L'entreprise se vante de l'amélioration de l'intelligence de Siri lors d'événements organisés tous les deux ans, et pourtant il continue d'échouer dans l'exécution des tâches les plus basiques sur mon poste. Qu'est-ce qui garantit que le prochain Siri ne sera pas aussi mauvais ?

Apple avait l'occasion de mettre Google et le reste du monde de l'IA en garde avec l'iPhone 16. Au lieu de cela, il a seulement montré à quel point l'intelligence d'Apple a encore besoin d'apprendre.